Sur le papier, un module scénarisé peut cocher toutes les cases. Le scénario tient debout, les dialogues sonnent juste, l’expérience paraît engageante. Parfois même franchement réussie.

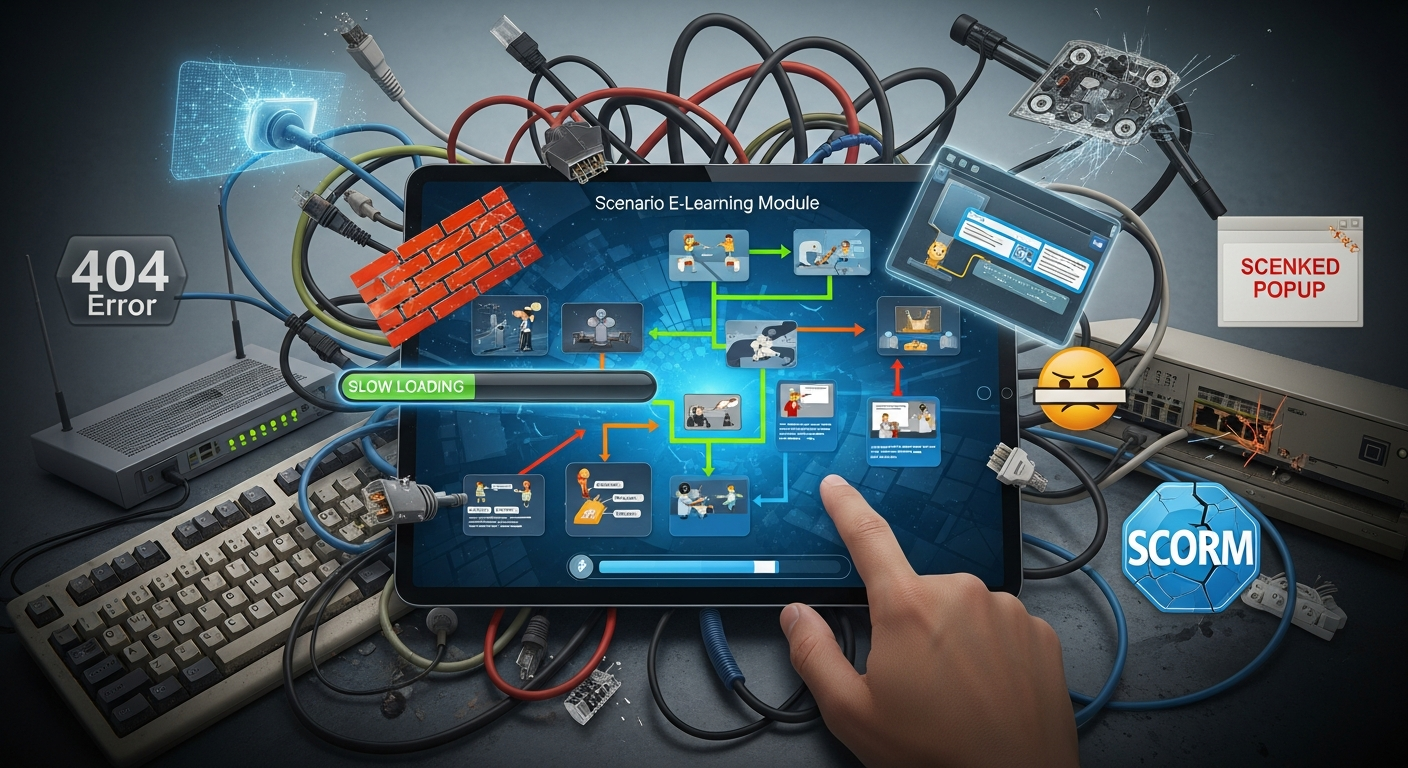

Et puis arrive le moment du déploiement e-learning scénarisé. C’est là, souvent, que les choses se compliquent, pas au niveau de l’idée, mais au niveau du réel. Le terrain, les usages, les machines, le LMS, les contraintes réseau, les habitudes des apprenants, l’implication (ou non) des managers, tout ce qui ne se voit pas toujours pendant la conception.

C’est aussi là que se joue la différence entre un module qui produit quelque chose de tangible et un module qui promet beaucoup mais laisse une impression floue. Un score mal remonté. Une reprise qui part de travers. Une scène mal comprise. Un son qui ne se déclenche pas. Un navigateur trop verrouillé. Une communication de lancement inexistante. Pris séparément, ce sont de « petits » problèmes. Ensemble, ils suffisent à casser l’effet.

Avant même de parler publication, il y a donc trois verrous à poser :

- ce qu’on veut faire apprendre, concrètement ;

- les conditions réelles dans lesquelles le module va tourner ;

- la manière dont on va l’introduire, le soutenir, l’accompagner.

Quand ces trois bases sont fragiles, le reste suit rarement.

Déploiement e-learning scénarisé : ce n’est pas juste mettre un SCORM en ligne

On parle ici de simulations, de serious games, de mises en situation, de parcours à embranchements. Des modules où l’apprenant ne se contente pas de cliquer sur « suivant » : il choisit, il teste, il se trompe, il recommence, il influe, selon le dispositif, sur la suite.

Dans ce genre de format, publier un package n’est que le début. Ce qu’il faut vraiment vérifier, c’est autre chose : est-ce que l’expérience tient une fois sortie de l’atelier ? Est-ce qu’elle reste lisible, stable, traçable ? Est-ce qu’elle fonctionne sans surprise sur le LMS visé ? Et si on doit la faire évoluer dans six mois, est-ce que tout va casser au moindre changement ?

C’est ce qui rend ces modules plus sensibles qu’un parcours linéaire classique. Dans un module standard, le chemin est fermé, maîtrisé d’un bout à l’autre. Ici, non. Une bifurcation, en apparence anodine, crée vite plusieurs réalités à gérer : plus de tests, plus de règles, plus de maintenance, plus de variables, plus de risques d’incohérence.

Ajoutez à ça un point souvent minimisé : dans ces dispositifs, on évalue fréquemment des compétences fines. La posture. La communication. Le discernement. La relation client. Le management. Du coup, si le tracking raconte mal ce qui s’est passé, ou si l’interface brouille la consigne, on finit par attribuer à l’apprenant une faiblesse qui vient peut-être du module lui-même.

C’est un cas fréquent, y compris sur des modules bien scénarisés conçus avec des outils comme VTS Editor : l’écriture est solide, parfois excellente, mais la preuve de l’impact se joue ailleurs. Au moment du lancement et de la mise en ligne.

Ce qu’on attend vraiment au moment d’un lancement e-learning scénarisé

En général, les attentes sont très concrètes. On veut éviter les pépins visibles dès le jour J. On veut que le LMS renvoie des données compréhensibles. On veut faire la différence entre « l’apprenant est allé au bout » et « l’apprenant a montré quelque chose de satisfaisant ». On veut aussi pouvoir défendre le dispositif devant les RH, les métiers, le management, parfois la conformité. Et si possible, on veut arrêter de repartir de zéro à chaque nouveau projet.

Les mêmes questions reviennent, encore et encore :

- comment éviter que les apprenants coincent dans les premières minutes ;

- comment obtenir des statuts LMS qui veulent vraiment dire quelque chose ;

- comment définir la réussite dans un module non linéaire ;

- comment prouver qu’on mesure autre chose qu’un taux de complétion ;

- comment transformer un bon lancement en méthode réutilisable.

Les dix pièges qui suivent découlent directement de ça.

Objectifs, gamification, non-linéaire : 4 pièges qui fragilisent le déploiement e-learning scénarisé

Lancer sans objectif observable

Un module immersif peut être séduisant et pourtant ne rien prouver d’utile.

Si l’objectif reste flou, impossible, ou presque, de démontrer un effet réel. « Sensibiliser à la relation client », par exemple, c’est une intention. Pas un objectif mesurable.

Quand on formule quelque chose comme : « identifier l’émotion du client, reformuler avant de proposer une solution, sans promettre un délai intenable », là on tient quelque chose. On peut observer le comportement. Donc l’évaluer. Donc le tracer. Donc parler d’impact avec un minimum de sérieux.

Avant la mise en production, il vaut mieux cadrer explicitement :

- le comportement visé ;

- le moment précis où il est mis à l’épreuve dans le scénario ;

- l’indicateur retenu ;

- la donnée attendue dans le LMS.

Exemple simple : dans une simulation d’entretien, l’écoute active est testée sur trois décisions-clés. Deux réponses adaptées sur trois : le module passe en « Réussi ». En dessous : remédiation, puis nouvel essai selon la même règle. Rien de sophistiqué. Mais c’est clair, défendable, exploitable.

Récompenser la mécanique de jeu au lieu de renforcer la compétence

La gamification n’est pas le problème. Le souci, c’est la gamification décorative. Celle qui ajoute du score, des badges ou de la vitesse sans lien solide avec l’apprentissage.

À partir du moment où le dispositif valorise surtout la rapidité, le clic efficace ou l’accumulation de points, il commence à entraîner autre chose que ce qu’il prétend développer. Les apprenants le perçoivent vite. Ils jouent le système. Ils visent le score. Pas forcément le bon geste.

Une mécanique ludique a un intérêt pédagogique si, et seulement si, elle aide à mieux faire trois choses :

- clarifier ce qui est attendu ;

- rendre les conséquences visibles ;

- soutenir la progression.

Prenons un module sur la gestion de conflit. Si l’apprenant coupe sèchement la parole à son interlocuteur, la scène doit le rendre sensible tout de suite : crispation, fermeture, hausse de tension, perte de coopération. Retirer quelques points, seul, ne suffit pas. C’est trop abstrait. Un feedback situé, inscrit dans la scène, apprend bien davantage.

Dans VTS Editor, ça passe souvent par des scores par compétence, des retours contextualisés, parfois des badges, mais uniquement quand ils marquent une vraie étape pédagogique, pas juste un effet de surface.

Multiplier les embranchements jusqu’à rendre le module ingérable

La non-linéarité impressionne. Elle rassure parfois aussi certains commanditaires. Plus il y a de branches, plus le module « fait riche », « fait avancé ».

Sauf que, dans la vraie vie, ça peut vite devenir une fausse bonne idée.

Chaque embranchement supplémentaire ajoute de la dette : davantage de cas à tester, plus de combinaisons, plus de maintenance, plus de zones grises, plus de possibilités qu’un état incohérent apparaisse quelque part. Et souvent, pour un gain pédagogique assez modeste.

La bonne question n’est donc pas : combien de branches peut-on créer ? La bonne question, c’est : quelle non-linéarité apporte vraiment quelque chose à l’apprentissage ?

Très souvent, quelques décisions structurantes suffisent. Le reste peut être géré par des micro-variations plus sobres : un ton différent, une conséquence brève, une réaction de personnage, un feedback ciblé sur une compétence précise.

Deux réflexes rendent le tout beaucoup plus robuste :

- adopter des conventions de nommage nettes pour les variables, états, sorties et compétences ;

- prévoir un chemin de secours lorsqu’un état inattendu survient.

Parce qu’un apprenant bloqué dans une scène impossible à poursuivre, c’est le genre de détail qui ruine instantanément l’expérience. Une sortie simple, même imparfaite, vaut mieux qu’un mur.

Confondre problème pédagogique et problème d’UX

L’immersion ne dispense pas de guider.

Dans un module scénarisé, l’apprenant ne devrait pas passer de longues secondes à se demander ce qu’on attend de lui, où cliquer, pourquoi sa réponse est considérée comme adaptée ou non. Quand ça arrive, on est souvent face à un problème d’UX, pas à une difficulté de fond.

C’est un glissement classique : on attribue à la compétence ce qui relève en réalité de l’interface, des consignes, du rythme ou du niveau d’aide.

Si 60 % des utilisateurs butent au même endroit, mieux vaut commencer par vérifier si la tâche est comprise.

Exemple : une scène d’exploration demande d’identifier deux signaux faibles dans un bureau. Si la mission est formulée à moitié, certains vont cliquer au hasard, d’autres n’oseront rien faire, d’autres encore vont croire qu’il faut tout ouvrir. Le bon réflexe consiste à annoncer l’objectif clairement, puis à faire apparaître un indice progressif si rien ne se passe. On ménage l’autonomie sans fabriquer de frustration inutile.

Le rythme joue aussi énormément. Une courte info, une action, un retour, puis une respiration. S’il n’y a que de l’exposition, ou si l’action arrive trop tard, l’attention baisse. Et l’abandon monte, tranquillement mais sûrement.

Pour cadrer l’UX et la charge mentale, les recommandations du Nielsen Norman Group restent une base solide.

Tests, SCORM, médias : 3 étapes clés pour un déploiement e-learning scénarisé fiable

Tester sur son poste et croire que le travail est fait

Celle-ci coûte cher. Souvent plus cher qu’on l’imagine.

Chez le concepteur, tout fonctionne. Le module se lance, les médias passent, les boutons répondent, le score remonte. Nickel.

Puis, une fois publié, les ennuis débarquent : proxy, VPN, navigateur verrouillé, machines vieillissantes, politique d’autoplay, réseau lent en agence, casque absent, audio bloqué, performances irrégulières. Et là, surprise (ou pas).

Le poste de conception n’est pas un environnement de vérité. C’est un environnement confortable.

Même un plan de test assez léger devrait couvrir, au minimum :

- le lancement et le chargement du module ;

- les interactions sensibles : choix, clics, timers, reprise ;

- l’audio et la vidéo ;

- la fin du parcours et les statuts associés ;

- la reprise après interruption.

Et surtout, il faut faire ces tests dans le LMS cible. Pas uniquement avec un lecteur SCORM local. Un lecteur local peut rassurer, il ne valide pas le déploiement.

Réglages SCORM et LMS faits trop tard, ou « à peu près »

Dans ce type de projet, le module n’est pas seulement un objet pédagogique. Il devient aussi une donnée de suivi, parfois une donnée RH. À partir de là, l’approximation coûte cher en crédibilité.

Si le LMS affiche « Terminé » alors que l’apprenant n’a jamais atteint le niveau attendu, ou si le score remonté ne correspond pas à l’expérience vécue, la confiance s’abîme vite. Ensuite, bon courage pour défendre les reportings.

La règle de réussite doit donc être décidée avant la livraison. Pas à la fin, à la va-vite, quand il faut « faire remonter quelque chose ».

Il faut trancher explicitement :

- ce qui déclenche la complétion ;

- ce qui déclenche la réussite ou l’échec ;

- quel score, exactement, est interprété ;

- ce qui se passe en cas de reprise.

Dernière scène ? Dernier checkpoint ? Reprise depuis le début ? Chacun de ces choix a des conséquences directes sur la lisibilité des données.

Ensuite, il faut tester dans le LMS cible au moins quatre situations :

- un parcours réussi ;

- un parcours échoué ;

- une session interrompue puis reprise ;

- une session abandonnée (fermeture brutale ou sortie navigateur).

Pour le cadre standard, la référence reste la documentation ADL sur SCORM : https://adlnet.gov.

Sous-estimer le poids des médias

Un module peut sembler propre et pourtant se dégrader, presque en silence, à cause de ses médias.

C’est souvent là que se logent les irritants les plus pénibles : temps de chargement trop long, vidéo saccadée, audio désynchronisé, niveaux sonores qui varient d’une scène à l’autre, package trop lourd. Rien de spectaculaire, mais largement de quoi casser l’immersion et faire grimper le décrochage.

Le plus simple, c’est de standardiser tôt.

Quelques repères utiles :

- pour la vidéo, viser la bonne résolution, pas la plus grosse ;

- pour l’audio, harmoniser les niveaux de voix et d’ambiance ;

- pour les images, compresser proprement et éviter les formats inutilement lourds.

Une simulation de relation client n’a pas besoin d’une qualité brute « cinéma ». Elle a besoin de fluidité, de lisibilité, de signaux propres.

Avec VTS Editor comme avec d’autres outils auteurs, suivre les recommandations de formats limite aussi les écarts selon les postes. Et mieux vaut tester au moins sur deux configurations matérielles : casque standard et haut-parleurs d’ordinateur, par exemple.

Sécurité, pilote, communication : 3 leviers pour réussir le déploiement d’un module scénarisé

Découvrir les contraintes réseau et sécurité après le lancement

Beaucoup d’incidents n’ont rien à voir avec le scénario. Ni même avec le LMS. Ils viennent du contexte d’entreprise, tout simplement.

Liens externes bloqués. Popups interdites. Appels API filtrés. Ressources distantes inaccessibles via VPN. Pare-feu plus strict selon les sites. Un module peut tourner parfaitement au siège et se casser dès qu’on sort de cet environnement.

Conclusion : l’IT doit être impliquée tôt. Pas quand les tickets commencent à tomber.

Une liste claire des dépendances évite déjà pas mal d’allers-retours :

- domaines nécessaires ;

- popups à autoriser, si besoin ;

- appels externes ;

- contraintes spécifiques liées au VPN.

Deux points méritent une attention quasi systématique. D’abord, les popups sont souvent bloquées par défaut. Ensuite, le VPN peut dégrader fortement les temps de chargement. Si la cible travaille à distance, ce cas doit être testé pour de vrai, pas supposé.

Et quand une ressource externe est critique, mieux vaut prévoir une roue de secours : une version intégrée au module, ou au moins un message de repli clair expliquant comment accéder autrement à l’information.

Faire l’impasse sur un pilote terrain

Un pilote n’est pas là pour faire joli dans le planning. C’est souvent le moment où le module rencontre enfin le réel.

Et le réel, lui, ne lit pas les intentions de conception.

Un bon pilote ne cherche pas tellement à « valider globalement le dispositif ». Il sert surtout à vérifier trois choses simples :

- la crédibilité métier ;

- la clarté d’usage ;

- l’absence de friction majeure.

Il n’a pas besoin d’être interminable, mais il doit être représentatif. Mélanger des profils novices et expérimentés aide beaucoup. Ajouter au moins une situation contrainte (poste ancien, réseau faible, environnement verrouillé) est même recommandé. C’est souvent là que les faiblesses sortent.

Pour recueillir des retours utiles, quelques questions suffisent :

- à quel moment avez-vous hésité sur l’action attendue ;

- qu’est-ce qui vous a semblé peu crédible ;

- avez-vous rencontré un problème technique ;

- le feedback vous a-t-il aidé à progresser.

Et il faut regarder les traces. Vraiment. Un pic d’abandon à un endroit précis parle souvent avant tout le reste.

Pour appuyer le rôle des tests en conditions réelles et de l’apprentissage par l’action, vous pouvez aussi citer des travaux de recherche sur l’efficacité des simulations en formation, par exemple :

- Freeman et al. (2014), Active learning increases student performance in science, engineering, and mathematics (PLOS ONE)

- Sitzmann (2011), A meta-analytic examination of the instructional effectiveness of computer-based simulation games (Computers & Education)

Faire un lancement silencieux

Même un excellent module peut passer presque inaperçu s’il est lancé sans animation, sans cadrage, sans relais.

C’est un point souvent négligé, alors qu’un e-learning scénarisé a justement un vrai potentiel de présentation : on peut le positionner comme un espace d’entraînement, une répétition sans risque, un endroit où l’on a le droit d’essayer, de rater, de recommencer. Pas comme un simple contrôle déguisé.

Encore faut-il l’expliquer.

L’animation minimale doit rendre visibles quatre éléments :

- pourquoi ce module existe ;

- combien de temps il demande ;

- quand il doit être réalisé ;

- vers qui se tourner en cas de souci.

Deux leviers marchent particulièrement bien. D’abord, un relais managérial qui présente le dispositif comme utile, pas comme une contrainte de plus. Ensuite, un support visible et simple d’accès : une personne identifiée, un canal clair, pas un labyrinthe. Sans ça, beaucoup d’apprenants lâchent au premier obstacle, même mineur.

Checklist de déploiement pour un e-learning scénarisé (simple et réutilisable)

Le vrai enjeu n’est pas seulement de réussir un lancement. C’est aussi de rendre les suivants moins fragiles, plus rapides, plus fiables.

Et pour ça, pas besoin d’une usine à gaz. Une checklist courte et claire fait souvent le travail.

Pédagogie

- objectifs observables validés ;

- critères de réussite définis ;

- feedbacks essentiels présents.

UX

- consignes testées hors équipe projet ;

- aides progressives prévues ;

- équilibre correct entre temps passif et temps actif.

Technique

- tests réalisés dans l’environnement réel ;

- médias optimisés ;

- reprise validée.

SCORM / LMS

- complétion, réussite et score vérifiés dans le LMS cible ;

- cas réussi, échoué, interrompu et abandonné testés.

Sécurité / IT

- dépendances validées : proxy, pare-feu, popups, domaines ;

- solution de repli prévue pour les ressources externes.

Déploiement

- pilote terrain mené ;

- communication prête ;

- support prêt lui aussi.

Ressources et liens utiles pour cadrer un déploiement e-learning scénarisé

Quand il faut justifier une décision technique ou de conception, mieux vaut s’appuyer sur des sources solides que sur des habitudes internes.

- ADL, pour les standards SCORM et la documentation e-learning : https://adlnet.gov

- Nielsen Norman Group, pour les bases UX : https://www.nngroup.com

Pour aller plus loin côté Serious Factory :

- Outil de conception de modules E-Learning gamifiés facilité grâce à l’IA

- Plateforme LMS simple et efficace pour le déploiement et l’évaluation des compétences

- Mises en situation interactives

- Cas clients, découvrez leurs succès avec Virtual Training Suite

FAQ Déploiement e-learning scénarisé

Comment distinguer un module « réussi » d’un module seulement « terminé » dans le LMS ?

Il faut poser une règle claire. « Complété » quand l’apprenant atteint une fin de parcours. « Réussi » uniquement s’il atteint le seuil attendu, qu’il s’agisse d’un score global ou d’un niveau sur certaines compétences. Ensuite, cette logique doit être testée dans le LMS avec au moins un cas réussi et un cas échoué.

Quels sont les tests minimum avant publication d’un SCORM de simulation ou de serious game ?

Au minimum : lancement, chargement, interactions critiques, audio/vidéo, fin de module, remontée de la complétion et du score, puis reprise après interruption. Et ces vérifications doivent être faites dans le LMS cible, pas uniquement en local.

Pourquoi le module marche chez moi mais pas chez les apprenants ?

Parce que le problème est souvent lié à l’environnement réel : proxy, pare-feu, VPN, navigateur imposé, poste moins performant, politiques de lecture audio, restrictions locales. Tant que les tests ne sont pas faits dans les conditions de la cible, l’écart reste invisible.

Comment éviter qu’un apprenant se retrouve bloqué dans une scène interactive ?

En travaillant d’abord l’UX : consignes explicites, mission claire, indices progressifs en cas d’inactivité, et chemin de secours lorsqu’un état inattendu survient. Une bonne partie des blocages vient d’attentes implicites mal formulées.

Comment rendre les prochains déploiements plus rapides et plus fiables ?

En formalisant une méthode légère : checklist commune, pilote terrain court mais représentatif, validation LMS systématique, puis amélioration continue à partir des retours et des données.